-

Noticiero difunde video falso del Presidente de Ucrania y pide que lo borren de redes.

-

Alertan a soldados y población por los “deepfake” que circulan durante la guerra.

-

Zelensky asegura que no será realidad la rendición de sus fuerzas ante Rusia.

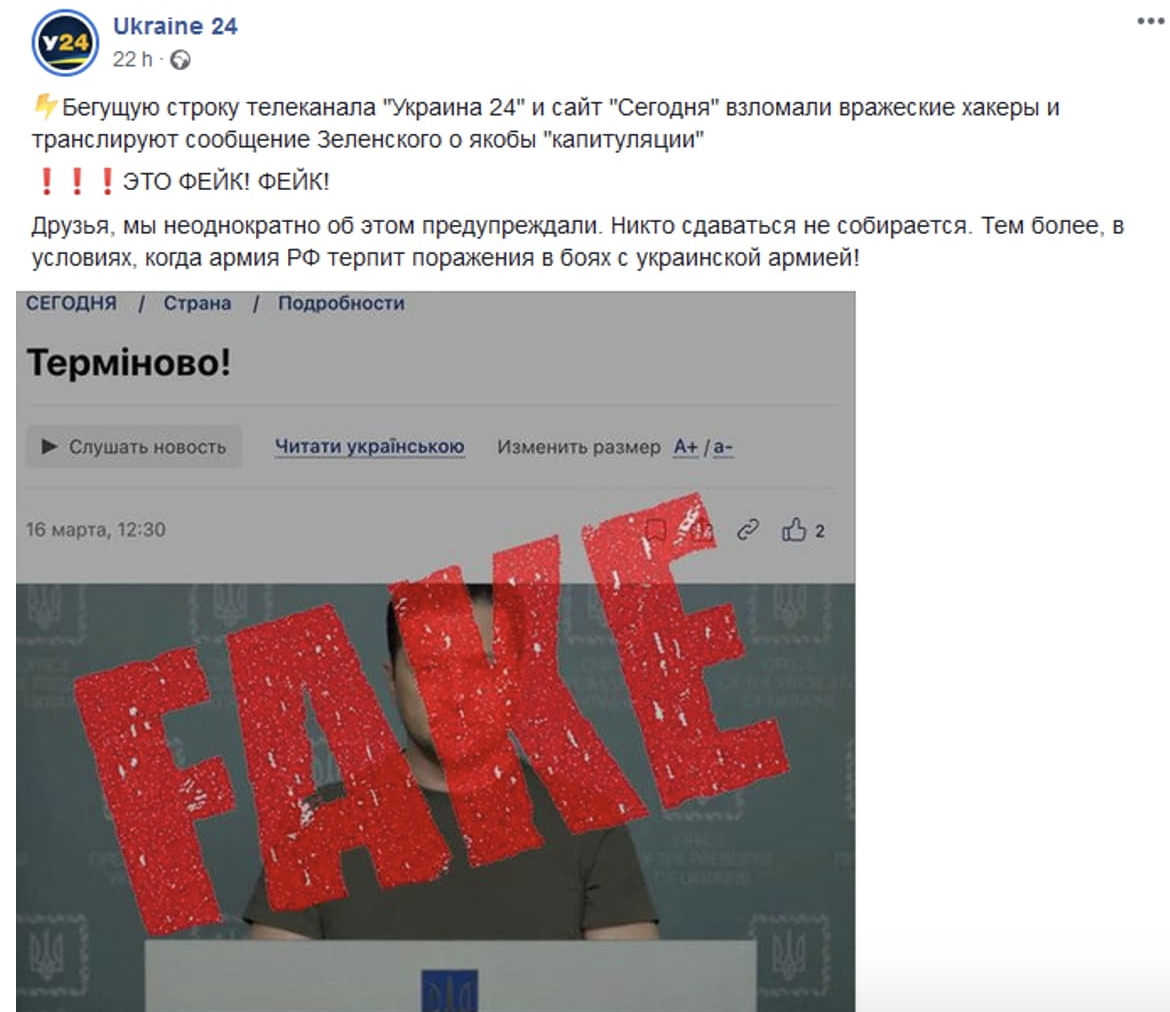

El canal nacional “Ucrania 24” fue víctima del “deepfake” y representó el verdadero riesgo de la Inteligencia Artificial (IA) para los medios de comunicación y la difusión de fake news, pues se les coló un video falso del Presidente ucraniano, Volodymyr Zelensky, donde aparentemente se rendía en la guerra con Rusia.

Y es que, en plena invasión, el montaje del líder llamando a su país a “deponer las armas” causó alerta y confusión por ser transmitido en un noticiero, lo que rápidamente lo hizo viral en redes sociales pese a que la producción dijo haber sido hackeada.

De acuerdo con Ucrania 24, ayer por la noche el canal fue invadido mientras se encontraba al aire y su página web dejó de funcionar como debía.

“Sobre la última provocación infantil, sugiriendo que pida la entrega de las armas. Puedo ofrecer a los militares de la Federación Rusa que depongan las armas y se vayan a casa. Ya estamos en casa. Nuestro país, nuestros hijos, nuestras familias. Y estamos absolutamente reacios a deponer las armas. Hasta la victoria”.

“Recomiendo que depongan las armas y regresen con sus familias. No deben morir en esta guerra. Les pido que vivan y pretendo hacer lo mismo”, se escucha declarar al jefe de Estado ucraniano en el video falso.

El noticiero de Ucrania compartió el video en una publicación de Facebook con la etiqueta “falso” en grande y con color rojo, sin más explicación sobre el hackeo. Poco después, miembros de la producción noticiosa hicieron un hilo con los hechos y pidiendo disculpas públicas a la población que pudo llegar a espantarse y a pensar que su nación había sido tomada por la fuerza por las fuerzas armadas de Vladimir Putin.

Por su parte, Meta anunció que eliminó rápidamente el video, el director de seguridad de la empresa lo anunció en Twitter.

“Hoy temprano, nuestros equipos identificaron y eliminaron un video falso que afirmaba mostrar al presidente Zelensky emitiendo una declaración que nunca hizo. Apareció en un sitio web supuestamente comprometido y luego comenzó a mostrarse en Internet”, publicó Nathaniel Gleicher, miembro de Ucrania 24, en Twitter.

1/ Earlier today, our teams identified and removed a deepfake video claiming to show President Zelensky issuing a statement he never did. It appeared on a reportedly compromised website and then started showing across the internet.

— Nathaniel Gleicher (@ngleicher) March 16, 2022

El Presidente Zelensky habló después de la transmisión del “deepfake” en un breve extracto filmado desde su teléfono inteligente y transmitido por Ucrania 24, donde llamó a la población a la calma y fijó su postura de lucha.

El peligro del “deepfake”

Este tipos de videos están ganando popularidad en redes sociales e internet, pues consisten en una tecnología con Inteligencia Artificial (IA) que busca imitar la voz y apariencia de cualquier persona para transmitir mensajes falsos.

El objeto particular del “deepfake” es manipular a la audiencia y la opinión pública con respecto a alguna figura de alta posición.

Por ejemplo, en el caso del video falso de Zelensky se puede detectar el truco por el tamaño de la cabeza que parece estar fuera de sintonía con el resto del cuerpo, así como la voz más profunda.

A principios de marzo, las autoridades ucranianas advirtieron del creciente riesgo de “deepfakes”. El gobierno de Ucrania había pedido ayuda a Facebook para evitar más desinformación durante la guerra y para llamar a los soldados a estar atentos cuando vean videos del presidente que pudieran estar manipulados.

Pero Zelensky no fue la única víctima, también desde el 24 de febrero, cuando inició la invasión, el Presidente ruso Vladimir Putin se viralizó en TikTok por una serie de “deepfakes” donde se ridiculizaba su imagen.

Ahora lee:

Shift: El futuro del marketing es hoy y el nuevo libro de PHD te explica cómo aprovecharlo

Niña ucraniana con un rifle se viraliza y refleja el impacto de la fotografía para las masas

Cambiarían de empleo en 2023 más de la mitad de los millennials y centennials